Hey大家,

最近我讀了一篇由Tim Urban寫的What’s Our Problem? A Self-Help Book for Societies這本書中所摘錄下來的一小節 — Introduction: The Big Picture。

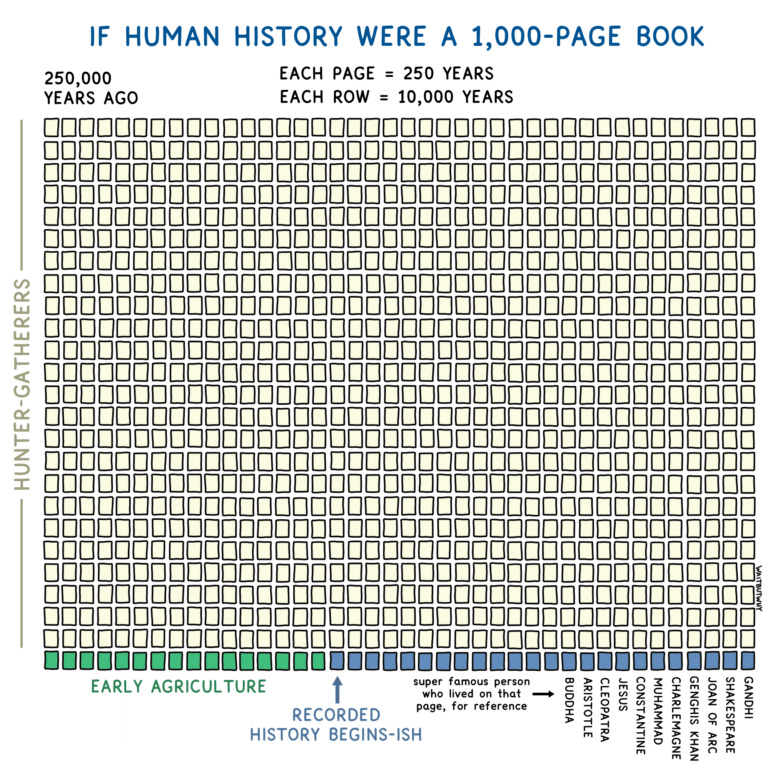

這篇文章的開頭就提出,如果我們將所有人類歷史寫入一本叫做The Story of Us的書中。以人類從20萬~30萬年前就存在在地球上來看,假如我們把每250年的人類歷史寫成一頁,那這本The Story of Us就是總共有1000頁的厚書。

如果我們把整本書攤開來(像是上面這張圖一樣),我們會發現所有我們認為的古老歷史,其實都發生在整本書的最後幾頁,舉例來說:

農業革命發生在950-960頁左右

976頁之後才有被記錄下來的人類歷史

基督教在993頁才出現

整個美國歷史都被囊括在第1000頁當中

而我們也正在(冒險地)邁向這本書的第一千零一頁。

而當我們如探險者般想要為人類文明開闢出這第一千零一頁時,作者Tim在這篇文章中提出了三個讓他既興奮卻也擔憂的事實,分別是:科技的指數型成長、更多的科技帶來的更高風險,和相對不成熟的社會。前兩者比較直觀,所以我把前兩點合併成一個section,而第三點我會著墨多一些。

科技的指數型成長 & 更多的科技帶來的更高風險

科技的指數型成長相信不太需要我來贅述,從以前的農耕時代、日出而作日落而息,到工業革命、蒸汽機的發明取代勞力、電燈解鎖了人類的夜晚,一直到現代的電腦、網路、人工智慧等等。我們可以發現的有趣的是

越進步的社會進步得越快

文章中很有趣的例子是,如果你回到第760頁綁架一個人,再把他傳送到兩三百年後的第761頁,除了需要交新朋友以外,他應該還是可以照以前的方式過活,因為這世界的科技在這幾百年間幾乎沒什麼變化。但如果你把人從998頁綁架到999頁的話,他會因萬有引力、天文學、人權意識而驚嘆不已。更不用說如果從999頁到第1000頁了,這位被綁架來的朋友可能會因過度驚嚇而暈倒😵💫 基本上打開The Story of Us,當我們越往後翻,每多翻一頁,我們的下巴都會呈指數級地往下掉😱。

但好壞總是一體兩面。科技進步是把雙面刃,它帶來了更美好的時代,卻也帶來更糟糕的時代。文中舉出的例子像是:

在人類歷史的第999頁中,啟蒙運動和科學革命帶來了人類繁榮的巨大進步,但也帶來了奴隸制和殘酷帝國主義的爆發。

在第1,000頁,人類享有前所未有的壽命、財富和政治自由,但也經歷了有史以來最災難性的兩次戰爭,接著是核武器、生物武器的出現和氣候變化的影響。

在發展科技時,我們通常更注重在科技好的一面:它能解決什麼問題、能夠幫助多少人、能夠減少多少浪費等等,但與此同時我們卻常忽略了科技所帶來的風險和危機。當這些科技被拿來做壞事時,我們再發現時可能就已經來不及了。

相對不成熟的社會

如何應對科技進步隨之而來的高風險?作者說,我們每個人應該都需要成為最有智慧的自己。但事實卻不是如此,我們整個社會/文明都還呈現著遠遠不夠成熟的樣子 — 這是經我修飾後、很委婉的的說法。作者的原話是:

“My Society is currently acting like a pooty-pantsed four-year-old who dropped its ice cream” — Tim Urban

基本上如果我們整個社會是一個活生生的人的話,那他目前的表現就像一個冰淇淋掉在地上的哭哭四歲小孩(如上圖)。

這讓我想起了之前看到老高的一部影片【神作】三十分鐘講完阿米,宇宙基本法則,阿米對人類最後的警告,愛的真諦,人生在世的意義 中,老高提到外星人阿米說:

其實宇宙裡面沒有壞人,因為任何邪惡的文明都發展不起來,無法離開自己的星球,它們自己就內部毀滅了。在文明的發展過程中,一定是毀滅性武器先出現,然後才有探索宇宙、宇宙飛船。所以如果這個文明是邪惡的,那他們一定會在宇宙探索之前就因為內部爭鬥、使用毀滅性武器而自我滅亡。

我覺得滿有道理的,我們社會的成熟度成長的速度好像真的遠遠不及科技發展的速度。如何平衡這兩者是我們需要好好思考的問題。

KYs' murmur: 雖然老高的影片很多點不是完全正確,但許多內容還是很可以激發我的思考以及想像力🤣最近的大型語言模型(ex: GPT-4)有點像是個科技奇異點的存在、將科技推往另一個高度,讓我們離科幻電影中的通用人工智慧(AGI, Artificial general intelligence)又更近了一步。但與此同時,它強大的能力也讓我們開始懼怕,包含Elon Musk (Tesla/SpaceX/Twitter CEO)、Yoshua Bengio (圖靈獎得主)、Stephen Wozniak (Apple co-founder) 等多位知名人士連署了一份 呼籲所有 AI 實驗室立即暫停(暫停至少 6 個月)訓練比 GPT-4 更強的 AI 系統的公開信 — Pause Giant AI Experiments: An Open Letter,就是想要我們在發展科技的同時也停下來好好想想這些科技有可能帶來的風險、以及我們該如何防範。但當然,目前的大型語言模型有沒有達到那麼令人懼怕的程度似乎還有許多討論空間:

以實際應用來說,大型語言模型的確厲害到有點嚇人,讓人分不清是真人還是AI

但以演算法的角度來說,大型語言模型跟人類的大腦運作方式還是有很大的不同

因此也有許多AI界的大佬像是Yann LeCun(Meta首席AI科學家、圖靈獎獎得主)、Andrew Ng(史丹佛大學教授、Google Brain co-founder)等人也對這份公開信持反對態度。

不管誰對誰錯,社會總是需要有兩方互相抗衡之下才能持續進步。

破壞永遠比創造更簡單,世上依然戰亂頻繁、國家間維持著互相牽制的平衡。人總是在密碼被盜用之後才懊悔沒有重視資安、有人受傷後才會有較完整的法律規範。就算是那0.00001%可能的風險我們也不能輕易忽視,因為隨著科技指數性的加速發展,日漸升高的潛在危害可能將不是我們可以踩錯的一步。當我們現在準備提筆書寫人類歷史的第一千零一頁,在推進前沿科技的同時,我們也應該隨時把科技有可能帶來的災害放在心中!

Have a great week :)

-KY

Can I know your latest book list :) ?